基于Python爬取素材网站音频文件

基本环境配置

- python 3.6

- pycharm

- requests

- parsel

相关模块pip安装即可

目标网页

请求网页

import requests

url = 'https://www.tukuppt.com/peiyue/zonghe_0_0_0_0_0_0_1.html'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/81.0.4044.138 Safari/537.36',

}

response = requests.get(url=url, headers=headers)

解析网页,提取数据

import parsel

selector = parsel.Selector(response.text)

urls = selector.css('#audio850995 source::attr(src)').getall()

titles = selector.css('.b-box .info .title::text').getall()

data = zip(urls, titles)

for i in data:

mp3_url = 'https:' + i[0]

title = i[1]

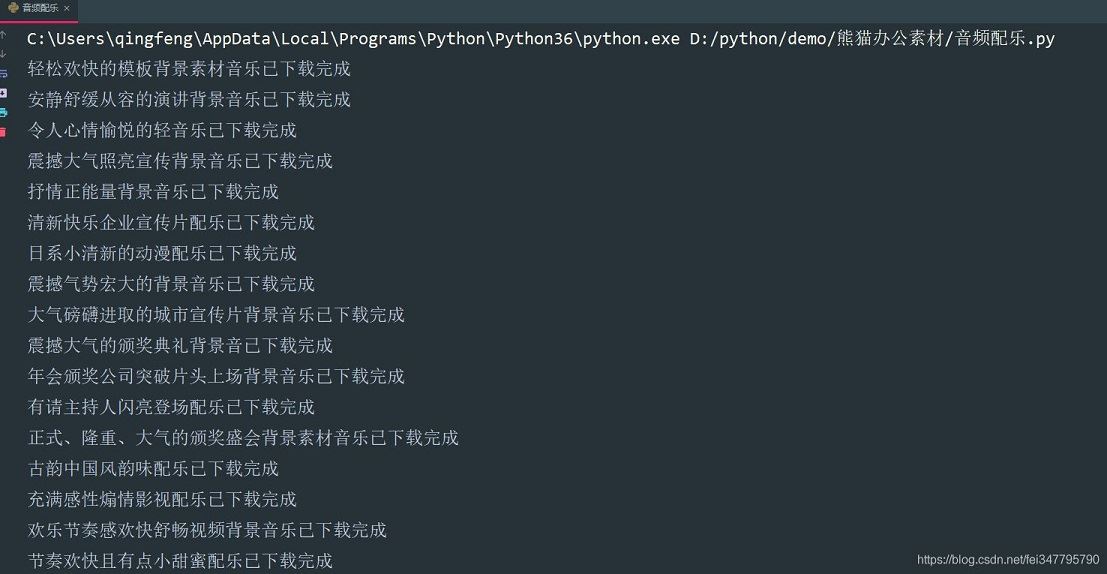

保存数据

def download(url, title):

response = requests.get(url=url, headers=headers)

path = 'D:\\python\\demo\\熊猫办公素材\\背景音乐\\' + title + '.mp3'

with open(path, mode='wb') as f:

f.write(response.content)

以上就是本文的全部内容,希望对大家的学习有所帮助,也希望大家多多支持我们。

相关推荐

-

python爬虫爬取笔趣网小说网站过程图解

首先:文章用到的解析库介绍 BeautifulSoup: Beautiful Soup提供一些简单的.python式的函数用来处理导航.搜索.修改分析树等功能. 它是一个工具箱,通过解析文档为用户提供需要抓取的数据,因为简单,所以不需要多少代码就可以写出一个完整的应用程序. Beautiful Soup自动将输入文档转换为Unicode编码,输出文档转换为utf-8编码. 你不需要考虑编码方式,除非文档没有指定一个编码方式,这时,Beautiful Soup就不能自动识别编码方式了.然后,你仅仅

-

python 爬取免费简历模板网站的示例

代码 # 免费的简历模板进行爬取本地保存 # http://sc.chinaz.com/jianli/free.html # http://sc.chinaz.com/jianli/free_2.html import requests from lxml import etree import os dirName = './resumeLibs' if not os.path.exists(dirName): os.mkdir(dirName) headers = { 'User-Agent

-

python爬虫使用正则爬取网站的实现

本文章的所有代码和相关文章, 仅用于经验技术交流分享,禁止将相关技术应用到不正当途径,滥用技术产生的风险与本人无关. 本文章是自己学习的一些记录.欢迎各位大佬点评! 首先 今天是第一天写博客,感受到了博客的魅力,博客不仅能够记录每天的代码学习情况,并且可以当作是自己的学习笔记,以便在后面知识点不清楚的时候前来复习.这是第一次使用爬虫爬取网页,这里展示的是爬取豆瓣电影top250的整个过程,欢迎大家指点. 这里我只爬取了电影链接和电影名称,如果想要更加完整的爬取代码,请联系我.qq 1540741

-

Python实现爬取需要登录的网站完整示例

本文实例讲述了Python爬取需要登录的网站实现方法.分享给大家供大家参考,具体如下: import requests from lxml import html # 创建 session 对象.这个对象会保存所有的登录会话请求. session_requests = requests.session() # 提取在登录时所使用的 csrf 标记 login_url = "https://bitbucket.org/account/signin/?next=/" result = se

-

python如何爬取网站数据并进行数据可视化

前言 爬取拉勾网关于python职位相关的数据信息,并将爬取的数据已csv各式存入文件,然后对csv文件相关字段的数据进行清洗,并对数据可视化展示,包括柱状图展示.直方图展示.词云展示等并根据可视化的数据做进一步的分析,其余分析和展示读者可自行发挥和扩展包括各种分析和不同的存储方式等..... 一.爬取和分析相关依赖包 Python版本: Python3.6 requests: 下载网页 math: 向上取整 time: 暂停进程 pandas:数据分析并保存为csv文件 matplotlib:

-

如何使用python爬虫爬取要登陆的网站

你好 由于你是游客 无法查看本文 请你登录再进 谢谢合作..... 当你在爬某些网站的时候 需要你登录才可以获取数据 咋整? 莫慌 把这几招传授给你 让你以后从容应对 登录的常见方法无非是这两种 1.让你输入帐号和密码登录 2.让你输入帐号密码+验证码登录 今天 先跟你说说第一种 需要验证码的咱们下一篇再讲 第一招 Cookie大法 你平常在上某个不为人知的网站的时候 是不是发现你只要登录一次 就可以一直看到你想要的内容 过了一阵子才需要再次登录 这就是因为 Cookie 在做怪 简单来说 就是

-

Python基于requests库爬取网站信息

requests库是一个简介且简单的处理HTTP请求的第三方库 get()是获取网页最常用的方式,其基本使用方式如下 使用requests库获取HTML页面并将其转换成字符串后,需要进一步解析HTML页面格式,这里我们常用的就是beautifulsoup4库,用于解析和处理HTML和XML 下面这段代码便是爬取百度的信息并简单输出百度的界面信息 import requests from bs4 import BeautifulSoup r=requests.get('http://www.bai

-

Python3 实现爬取网站下所有URL方式

获取首页元素信息: 目标 test_URL:http://www.xxx.com.cn/ 首先检查元素,a 标签下是我们需要爬取得链接,通过获取链接路径,定位出我们需要的信息 soup = Bs4(reaponse.text, "lxml") urls_li = soup.select("#mainmenu_top > div > div > ul > li") 首页的URL链接获取: 完成首页的URL链接获取,具体代码如下: ''' 遇到不

-

基于Python爬取素材网站音频文件

基本环境配置 python 3.6 pycharm requests parsel 相关模块pip安装即可 目标网页 请求网页 import requests url = 'https://www.tukuppt.com/peiyue/zonghe_0_0_0_0_0_0_1.html' headers = { 'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Ch

-

python 爬取壁纸网站的示例

本次爬虫用到的网址是: http://www.netbian.com/index.htm: 彼岸桌面.里面有很多的好看壁纸,而且都是可以下载高清无损的,还比较不错,所以我就拿这个网站练练手. 作为一个初学者,刚开始的时候,无论的代码的质量如何,总之代码只要能够被正确完整的运行那就很能够让自己开心的,如同我们的游戏一样,能在短时间内得到正向的反馈,我们就会更有兴趣去玩. 学习也是如此,只要我们能够在短期内得到学习带来的反馈,那么我们的对于学习的欲望也是强烈的. 作为一个菜鸡,能够完整的完整此次爬虫

-

python 爬取影视网站下载链接

项目地址: https://github.com/GriffinLewis2001/Python_movie_links_scraper 运行效果 导入模块 import requests,re from requests.cookies import RequestsCookieJar from fake_useragent import UserAgent import os,pickle,threading,time import concurrent.futures from goto

-

python爬取网页内容转换为PDF文件

本文实例为大家分享了python爬取网页内容转换为PDF的具体代码,供大家参考,具体内容如下 将廖雪峰的学习教程转换成PDF文件,代码只适合该网站,如果需要其他网站的教程,可靠需要进行稍微的修改. # coding=utf-8 import os import re import time import pdfkit import requests from bs4 import BeautifulSoup from PyPDF2 import PdfFileMerger import sys

-

基于Python爬取51cto博客页面信息过程解析

介绍 提到爬虫,互联网的朋友应该都不陌生,现在使用Python爬取网站数据是非常常见的手段,好多朋友都是爬取豆瓣信息为案例,我不想重复,就使用了爬取51cto博客网站信息为案例,这里以我的博客页面为教程,编写的Python代码! 实验环境 1.安装Python 3.7 2.安装requests, bs4模块 实验步骤 1.安装Python3.7环境 2.安装requests,bs4 模块 打开cmd,输入:pip install requests -i https://pypi.tuna.tsi

-

python 爬取吉首大学网站成绩单

项目地址: https://github.com/chen0495/pythonCrawlerForJSU 环境 python 3.5即以上 request.BeautifulSoup.numpy.pandas. 安装BeautifulSoup使用命令pip install BeautifulSoup4 配置及使用 登陆学校成绩单查询网站,修改cookie. 按F12后按Ctrl+R刷新一下,获取cookie的方法见下图: 修改爬虫url为自己的成绩单网址. 运行src/main.py文件即可在

-

使用python爬取taptap网站游戏截图的步骤

今天使用python写了一个简单的爬虫,用来下载taptap网站的游戏截图.下面说下具体的实现方法. 在搜索框中搜索"原神" 打开浏览器的开发者选项,从详情按钮里面跳转到游戏的页面,点击详情之后,跳转页面 这时候看到,浏览器地址:https://www.taptap.com/app/168332,tap官网的域名加上app/和图一的游戏id,可以使用re模块正则表达式模块从接口中获取到这个id x_ua = 'V=1&PN=WebApp&LANG=zh_CN&V

-

基于Python爬取搜狐证券股票过程解析

数据的爬取 我们以上证50的股票为例,首先需要找到一个网站包含这五十只股票的股票代码,例如这里我们使用搜狐证券提供的列表. https://q.stock.sohu.com/cn/bk_4272.shtml 可以看到,在这个网站中有上证50的所有股票代码,我们希望爬取的就是这个包含股票代码的表,并获取这个表的第一列. 爬取网站的数据我们使用Beautiful Soup这个工具包,需要注意的是,一般只能爬取到静态网页中的信息. 简单来说,Beautiful Soup是Python的一个库,最主要的

-

python爬取某网站原图作为壁纸

不得不说 python真是一个神奇的东西,学三天就能爬网站 真香 完整代码 # -*- coding: utf-8 -*- """ Created on Wed May 26 17:53:13 2021 @author: 19088 """ import urllib.request import os import pickle import re import random import sys #获取http代理 class getHttp

-

用python爬取租房网站信息的代码

自己在刚学习python时写的,中途遇到很多问题,查了很多资料,下面就是我爬取租房信息的代码: 链家的房租网站 两个导入的包 1.requests 用来过去网页内容 2.BeautifulSoup import time import pymssql import requests from bs4 import BeautifulSoup # https://wh.lianjia.com/zufang/ #获取url中下面的内容 def get_page(url): responce = re

随机推荐

- 详细谈谈AngularJS的子级作用域问题

- javascript alert乱码的解决方法

- 把Jar文件转成exe安装文件的实现方法

- System.Runtime.InteropServices.COMException的解决方法

- PHP实现删除多重数组对象属性并重新赋值的方法

- C#中数组Array,ArrayList,泛型List详细对比

- C#异步下载文件

- PowerShell函数参数设置为即可选又必选的方法

- NodeJS基础API搭建服务器详细过程记录

- MySQL索引背后的数据结构及算法原理详解

- js 图片等比例缩放代码

- jQuery实现订单提交页发送短信功能前端处理方法

- js获取指定的cookie的具体实现

- javascript 弹出层组件(升级版)

- 如何判断一个数是否为4的幂次方?若是,并判断出来是多少次方?

- 解决Android Studio 格式化快捷键和QQ 锁键盘快捷键冲突问题

- Laravel ORM对Model::find方法进行缓存示例详解

- C++实践数组类运算的实现参考

- Python 查看list中是否含有某元素的方法

- Java处理Webp图片格式转换的示例代码