C++利用opencv实现单目测距的实现示例

闲来无事,用C++做了一个简易的单目测距。算法用的cv自带的,改改参数就行。实现了读取照片测距,读取笔记本摄像头测距,读取视频测距三个功能。

为什么不用双目测距?因为没钱买摄像头……

原理:相似三角形原理,已知焦距的情况下检测被测物在图片中所占的像素宽度来判断被测物与摄像头的距离,同时也可以得出被测物的大概长宽。注意:摄像头要和被测物体平行,如果不平行在侧面看来摄像头和物体之间的连线就与水平方向有一个夹角a,被测物体在图片中的大小会受到影响,从而影响测量效果。

误差分析:导致测量效果不好的原因有很多,比如说摄像头与被测物没有在同一高度,摄像头标定的焦距不准确,不同视频拍摄的摄像头焦距不同,测量出来也不一样,所以测量前需要对摄像头进行标定处理得到焦距,这里使用的是传统的标定方法。

步骤:

①标定得出焦距

②对图片进行高斯滤波处理(平滑操作,过滤操作,去噪操作)

③边缘检测

④画出检测出的轮廓并返回最小的外接矩形(可以设置画出全部轮廓或者是最大的轮廓)

⑤计算距离

检测摄像头只需要把摄像头获取到的画面逐帧分析,就相当于对照片分析,视频也是一个道理。这里我设置了一个保存最小距离和最大距离的变量,当然这只能作为一个参考值并不是准确的,因为摄像头和视频测距都没有和被测物平行。

效果演示:

效果不稳定,对于单张图片效果有时候误差只有几厘米,有时候误差就几十厘米甚至超过一百厘米。这个测量的距离是图片中检测到的最小矩形到摄像头的距离,所以对于背景比较干净的矩形图片很好识别,识别的很规整,但是对于一些背景杂乱的图片,识别效果就差强人意。这里以两种不同的图片做对比。

其对应的图片处理效果如下(实际误差只有1厘米):

对于阳台的一棵树:

我也不知道我和这棵树距离有好远,测出来163cm,但是肯定超过了这个距离。

代码(拿了代码记得点赞评论一波哦):

没有分文件编写,配置好opencv就可以直接用,效果不保证,也就图一乐。

#include <opencv2/opencv.hpp>

#include <iostream>

using namespace cv;

using namespace std;

//2903.85 2438.65 2904.1

#define KNOWN_DISTANCE 70.866 //已知距离

#define KNOWN_WIDTH 0.787 //已知宽度0.787 11.69

#define KNOWN_HEIGHT 0.787 //已知高度0.787 8.27

//需要提前获取,通过标定步骤获得的

#define KNOWN_FOCAL_LENGTH 3000 //已知焦距

double MaxDistance= DBL_MIN;//最大距离

double MinDistance= DBL_MAX;//最小距离

void GetPicture(Mat& SrcImage, int choice);

void GetCamera(int choice);

void GetVideo(int choice);

double GetTheDistanceToCamera(double KnownWidth, double FocalLength, double PerWidth);

double CalculateFocalDistance(Mat& Image);

RotatedRect FindMarker(Mat& SrcImage);

A4纸尺寸:210mm×297mm(16开纸)

int main(int argv, char* argc[])

{

int choice = 0;

cout << "请输入你想选择的模式" << endl;

cout << "识别图片请输入:1" << endl;

cout << "实时摄像头识别请输入:2" << endl;

cout << "读取视频请输入:3" << endl;

cin >> choice;

if (choice == 1 ){

Mat SrcImage = imread("输入图片绝对路径在这里.jpg", IMREAD_COLOR);//获取图片

GetPicture(SrcImage,choice);

cout << "图像中检测过的轮廓中,最大距离为:" << MaxDistance << "cm" << endl;

cout << "图像中检测过的轮廓中,最小距离为:" << MinDistance << "cm" << endl;

}

else if (choice == 2) {

GetCamera(choice);

}

else if (choice == 3) {

GetVideo(choice);

}

}

void GetPicture(Mat& SrcImage,int choice) {

//以下程序用于标定相机获得“焦距”

namedWindow("输入窗口", 0);

resizeWindow("输入窗口", 600, 600);//限定窗口大小

imshow("输入窗口", SrcImage);//输出窗口

double FocalLength = 0.0;

FocalLength = CalculateFocalDistance(SrcImage); //获得焦距

//以下程序用于实际计算距离

RotatedRect Marker;

Marker = FindMarker(SrcImage);

double DistanceInches = 0.0;

DistanceInches = GetTheDistanceToCamera(KNOWN_WIDTH, KNOWN_FOCAL_LENGTH, Marker.size.width); //计算相机与目标之间的距离

DistanceInches = DistanceInches * 2.54; //转换成cm 1英寸=2.54厘米

//获取检测到的最大最小距离的范围

if (DistanceInches > MaxDistance)

MaxDistance = DistanceInches;

if (DistanceInches < MinDistance)

MinDistance = DistanceInches;

cout << "DistanceInches(cm):" << DistanceInches << endl; //显示的单位为厘米

putText(SrcImage, format("distance:%f", DistanceInches), Point(100, 100), FONT_HERSHEY_SIMPLEX, 2, Scalar(0, 0, 255), 10, LINE_8);//在图片上显示文本

namedWindow("输出窗口", 0);

resizeWindow("输出窗口", 600, 600);

imshow("输出窗口", SrcImage);

if (choice != 1) { //如果检测视频或者摄像头,就延时1ms,如果检测图片,就停留在当前帧

waitKey(1);

}

else if (choice == 1) {

waitKey(0);

}

}

void GetCamera(int choice) {

Mat frame;

VideoCapture capture(0);//读取视摄像头实时画面数据,0默认是笔记本的摄像头;如果是外接摄像头,这里改为1

while (true)

{

capture >> frame; //读取当前帧

GetPicture(frame,choice);

int key = waitKey(10);

if (key == 32) {

break;

}

}

cout << "图像中检测过的轮廓中,最大距离为:" << MaxDistance << "cm" << endl;

cout << "图像中检测过的轮廓中,最小距离为:" << MinDistance << "cm" << endl;

capture.release(); //释放摄像头资源

destroyAllWindows(); //释放全部窗口

}

void GetVideo(int choice) {

VideoCapture capture("视频的绝对路径.mp4");

Mat frame;

if (capture.isOpened()) //判断视频是否成功打开

{

//capture.grab() 从视频文件或捕获设备中抓取下一个帧

while (capture.grab()) {

capture >> frame;

GetPicture(frame,choice);

waitKey(1);

/*int key = waitKey(10);

if (key == 32) {

waitKey(0);

}

if (key == 27) {

break;

}*/

}

}

cout << "图像中最大距离为:" << MaxDistance << "cm" << endl;

cout << "图像中最小距离为:" << MinDistance << "cm" << endl;

waitKey();

}

double GetTheDistanceToCamera(double KnownWidth, double FocalLength, double PerWidth)

{

return (KnownWidth * FocalLength) / PerWidth; //计算目标到相机的距离 KnownWidth-为已知的目标的宽度 FocalLength-焦距 PerWidth-图像中宽度的像素数

}

RotatedRect FindMarker(Mat& SrcImage)//画出图形的边界并返回最小外接矩形

{

Mat GrayImage;

cvtColor(SrcImage, GrayImage, COLOR_BGR2GRAY);//将SrcImage复制给GrayImage

Mat GaussImage;

//将GrayImage通过高斯滤波处理后存放到GaussImage中

GaussianBlur(GrayImage, GaussImage, Size(3, 7), 3); //高斯滤波,对图像进行滤波操作(平滑操作、过滤操作,去噪操作)

Mat EdgeImage;

Canny(GaussImage, EdgeImage, 100, 200);//边缘检测

/*这段代码可省略,只是用来看效果。

namedWindow("复制图", 0);

resizeWindow("复制图", 600, 600);

imshow("复制图", GrayImage);

namedWindow("高斯滤波处理", 0);

resizeWindow("高斯滤波处理", 600, 600);

imshow("高斯滤波处理", GaussImage);

namedWindow("边缘检测处理", 0);

resizeWindow("边缘检测处理", 600, 600);

imshow("边缘检测处理", EdgeImage);

*/

vector<vector<Point>> Contours;

vector<Vec4i> Hierarchy;

findContours(EdgeImage.clone(), Contours, Hierarchy, RETR_TREE, CHAIN_APPROX_SIMPLE /*,Point(10,20)*/);//检测物体轮廓

double Area = -1;

int Index = -1;

for (int i = 0; i < Contours.size(); i++)//得到最大的轮廓然后画出来,其实是一个点集

{

if (contourArea(Contours[i]) > Area)

{

Area = contourArea(Contours[i]);

Index = i;

}

}

//第三个参数为-1的时候就画出全部轮廓

drawContours(SrcImage, Contours, -1, Scalar(0, 0, 255), 10, LINE_8);//画出物体的轮廓

RotatedRect Rorect;

Rorect = minAreaRect(Contours[Index]); //得到被测物的最小外接矩形

return Rorect;

}

double CalculateFocalDistance(Mat& Image)//计算拍照相机的焦距

{

RotatedRect Marker;

Marker = FindMarker(Image);

double FocalLength = 0.0;

double FocalWide = 0.0;

FocalLength = (Marker.size.height * KNOWN_DISTANCE) / KNOWN_WIDTH; //计算焦距单位为图像像素 依据公式: F=(P*D)/W F-焦距 D-距离 P-像素宽度 W-目标的真实宽度(单位英寸)

FocalWide = (Marker.size.width * KNOWN_DISTANCE) / KNOWN_HEIGHT;

cout << "标定焦距:" << FocalLength << endl;

cout << "标定焦距:" << FocalLength << endl;

return FocalLength;

//1857.71

}

有关图像的算法都是已经封装好了改参数直接用就行了,没有涉及到什么需要自己写的高难度算法。

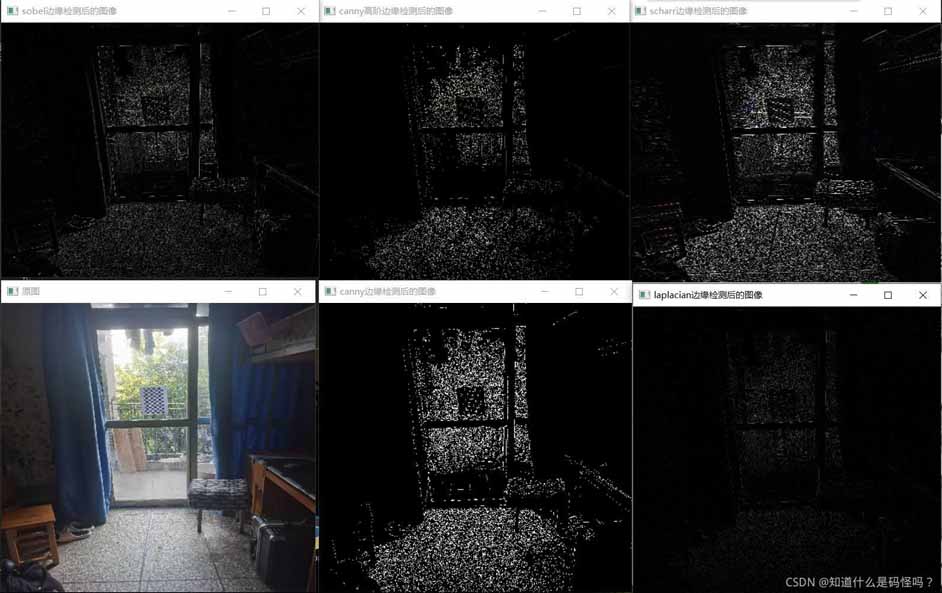

下面还有一些比较各个边缘检测效果的算法代码:

玩玩就行,原理我也不清楚,只会用现成的。

#include"opencv2/opencv.hpp"

using namespace cv;

using namespace std;

void main()

{

//显示原图像

Mat image = imread("C:/Users/蒋林宏/Desktop/图片/240A.jpg");

namedWindow("原图",0);

resizeWindow("原图", 600, 600);

imshow("原图", image);

//canny边缘检测的简单用法

Mat result;

Canny(image, result, 150, 70);

namedWindow("canny边缘检测后的图像",0);

resizeWindow("canny边缘检测后的图像", 600, 600);

imshow("canny边缘检测后的图像", result);

//高阶的canny用法,转成灰度图,降噪,用canny,最后将得到的边缘作为掩码,拷贝原图到效果图上,得到彩色边缘图

Mat grayimage, edge;

cvtColor(image, grayimage, COLOR_BGR2GRAY);

boxFilter(grayimage, edge, -1, Size(3, 3));

Canny(edge, edge, 150, 70);

Mat dst;

dst = Scalar::all(123);

image.copyTo(dst, edge);

namedWindow("canny高阶边缘检测后的图像",0);

resizeWindow("canny高阶边缘检测后的图像", 600, 600);

imshow("canny高阶边缘检测后的图像", dst);

//sobel算子边缘检测

Mat x_result, y_result;

Sobel(image, x_result, 0, 1, 0);

Sobel(image, y_result, 0, 0, 1);

addWeighted(x_result, 0.5, y_result, 0.5, 0, result);

/*imshow("sobel边缘检测后x轴的图像", x_result);

imshow("sobel边缘检测后y轴的图像", y_result);*/

namedWindow("sobel边缘检测后的图像",0);

resizeWindow("sobel边缘检测后的图像", 600, 600);

imshow("sobel边缘检测后的图像", result);

//laplacian边缘检测

Laplacian(image, result, 0);

namedWindow("laplacian边缘检测后的图像",0);

resizeWindow("laplacian边缘检测后的图像", 600, 600);

imshow("laplacian边缘检测后的图像", result);

//scharr滤波器

boxFilter(image, image, -1, Size(3, 3));

Scharr(image, x_result, 0, 1, 0);

Scharr(image, x_result, 0, 0, 1);

addWeighted(x_result, 0.5, y_result, 0.5, 0, result);

namedWindow("scharr边缘检测后的图像",0);

resizeWindow("scharr边缘检测后的图像", 600, 600);

imshow("scharr边缘检测后的图像", result);

waitKey();

}

效果:

说实话有点阴森。

到此这篇关于C++利用opencv实现单目测距的实现示例的文章就介绍到这了,更多相关C++ opencv单目测距内容请搜索我们以前的文章或继续浏览下面的相关文章希望大家以后多多支持我们!