Python 机器学习之线性回归详解分析

为了检验自己前期对机器学习中线性回归部分的掌握程度并找出自己在学习中存在的问题,我使用C语言简单实现了单变量简单线性回归。

本文对自己使用C语言实现单变量线性回归过程中遇到的问题和心得做出总结。

线性回归

线性回归是机器学习和统计学中最基础和最广泛应用的模型,是一种对自变量和因变量之间关系进行建模的回归分析。

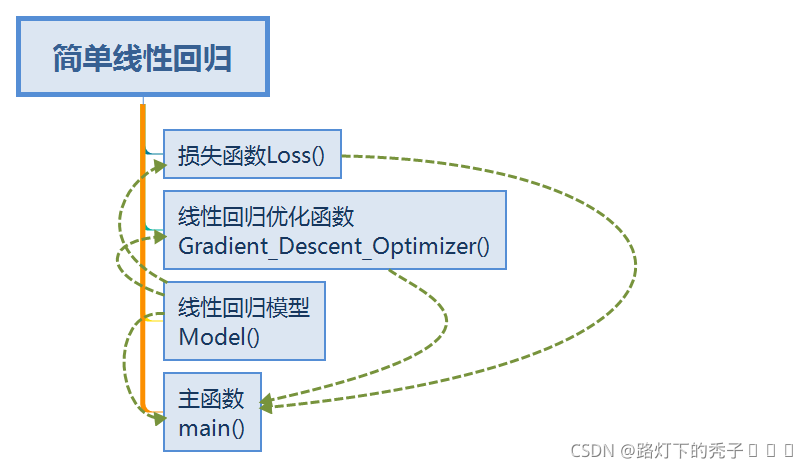

代码概述

本次实现的线性回归为单变量的简单线性回归,模型中含有两个参数:变量系数w、偏置q。

训练数据为自己使用随机数生成的100个随机数据并将其保存在数组中。采用批量梯度下降法训练模型,损失函数使用平方损失函数。

上图为整个程序的函数调用关系。

下面贴代码:

#include<stdio.h>

#include<stdlib.h>

#include<math.h>

#include<time.h>

double w, q;

int m;

//模型

float Model(float x)

{

float y;

y = x * w + q;

return y;

}

//损失函数

double Loss(float *y,float *x)

{

double L=0;

//循环参数

int i, j, k;

for (i = 0; i < m; i++)

{

L += (pow((y[i] - Model(x[i])), 2)) / (2 * m);

}

return L;

}

//梯度下降优化函数

void Gradient_Descent_Optimizer(float *x,float *y,float a)

{

int j, i;

double Q = 0, W = 0;

for (i = 0; i < m; i++)

W += x[i] * (Model(x[i]) - y[i]);

W = W / m;

for (j = 0; j < m; j++)

Q += Model(x[j]) - y[j];

Q = Q / m;

printf("W:%f\nQ:%f\n", W, Q);

w = w - a * W;

q = q - a * Q;

}

//主函数;训练过程

int main()

{

//循环标志

int i, j;

//训练轮次

int epoch;

//损失函数

double L;

//学习率

float a;

float x[100], y[100];

//随机数生成

for (i = 0; i < 100; i++)

{

x[i] = 0.1*i;

y[i] = x[i] * 3 + 5; //+ ((rand() % 11) / 10);

printf("X:%.2f,Y:%.2f\n", x[i], y[i]);

}

//超参数设置

m = 100;

a = 0.05;

epoch = 1000;

//参数初始化

w = 2;

q = 3;

for (j = 0; j < epoch; j++)

{

Gradient_Descent_Optimizer(x, y, a);

L = Loss(y, x);

printf("训练轮次:%d,损失:%f,参数w的值:%lf,参数q的值:%lf\n", j+1, L, w, q);

}

printf("最终值:\nw:%lf\nq:%lf\n", w, q);

system("pause");

}

问题总结

下面对在编写过程中需要注意的问题进行总结:

1.参数更新

模型中的参数需要同步更新。所有参数的更新值经过梯度下降法计算得出后要在最后同时更新所有参数。

2.保留损失函数

在代码编写过程中自己认为不用单独写一个损失函数,只需在梯度下降的过程中利用求导后的公式进行相关的参数优化操作即可,但在运行没有算是函数的程序时,没有实时的损失函数结果评估模型训练效果可能会导致模型在错误的道路上越走越远。

3.注意数据类型

初次运行程序,在训练至十几轮时参数就不再变化,一直到第1000轮参数都保持不变。后来在检查代码时发现,在优化函数将一些参数的数据类型错误设置为整型。因此当参数值改变程度小于1时,参数将不再变化。

4.超参数的设置及参数的初始化

学习率,训练轮次等的设置是一个对程序编写者经验要求比较高的工作,需要多次尝试,找到合适的值,参数的初始化也是这样。

心得

本次只是实现了简单线性回归的最基本的功能,同时也试一下自己刚买的机械键盘(用起来真的很舒服)。这只是我用来练手的程序,如果真的要编写程序实现功能还是推荐使用python语言搭配TensorFlow、Pytorch等深度学习平台实现自己想要的功能。程序的可完善空间非常大,比如数据和模型的可视化,将数据和模型的训练效果直观的展示出来,后面还会有序的用C语言实现诸如多元线性回归,二分类问题,多分类问题甚至卷积神经网络等等。我会在下面贴出使用Python语言编写的线性回归的程序,可以两者结合起来比较一下异同。

# -*- coding: utf-8 -*-

"""

Spyder Editor

This is a temporary script file.

"""

import matplotlib.pyplot as plt

import tensorflow as tf

import numpy as np

np.random.seed(5)

x_data = np.linspace(-1,1,100)

y_data = 2 * x_data + 1.0 + np.random.randn(*x_data.shape) * 0.4

np.random.randn(10)

#x_data.shape

#np.random.randn(*x_data.shape)

#np.random.randn(100)

plt.scatter(x_data,y_data)

plt.plot(x_data, 2 * x_data + 1.0, color = 'red',linewidth=3)

x = tf.placeholder("float",name="x")

y = tf.placeholder("float",name="y")

def model(x,w,b):

return tf.multiply(x,w)+b

w = tf.Variable(1.0,name="w0")

b = tf.Variable(0.0,name="b0")

pred = model(x,w,b)

train_epochs = 10

learning_rate = 0.05

loss_function = tf.reduce_mean(tf.square(y-pred))

optimizer = tf.train.GradientDescentOptimizer(learning_rate).minimize(loss_function)

sess = tf.Session()

init = tf.global_variables_initializer()

sess.run(init)

i_ci=0

for epoch in range(train_epochs):

for xs,ys in zip(x_data,y_data):

_, loss=sess.run([optimizer,loss_function],feed_dict={x:xs,y:ys})

b0temp=b.eval(session=sess)

w0temp=w.eval(session=sess)

plt.plot(x_data,w0temp*x_data+b0temp)

print("w:",sess.run(w))

print("b:",sess.run(b))

plt.scatter(x_data,y_data,label='Original data')

plt.plot(x_data,x_data*sess.run(w)+sess.run(b),label='Fitted Line',color='r',linewidth=3)

plt.legend(loc=2)

到此这篇关于Python 机器学习之线性回归详解分析的文章就介绍到这了,更多相关Python 机器学习内容请搜索我们以前的文章或继续浏览下面的相关文章希望大家以后多多支持我们!