基于python爬取链家二手房信息代码示例

基本环境配置

- python 3.6

- pycharm

- requests

- parsel

- time

相关模块pip安装即可

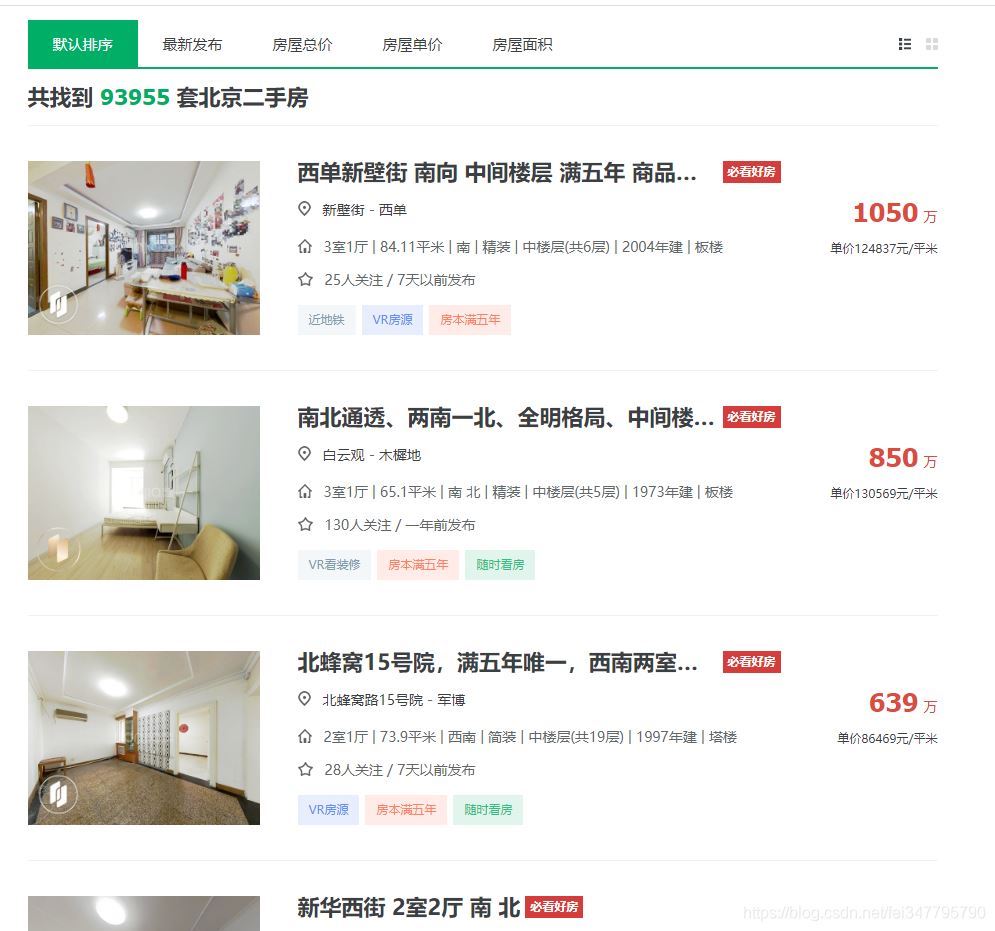

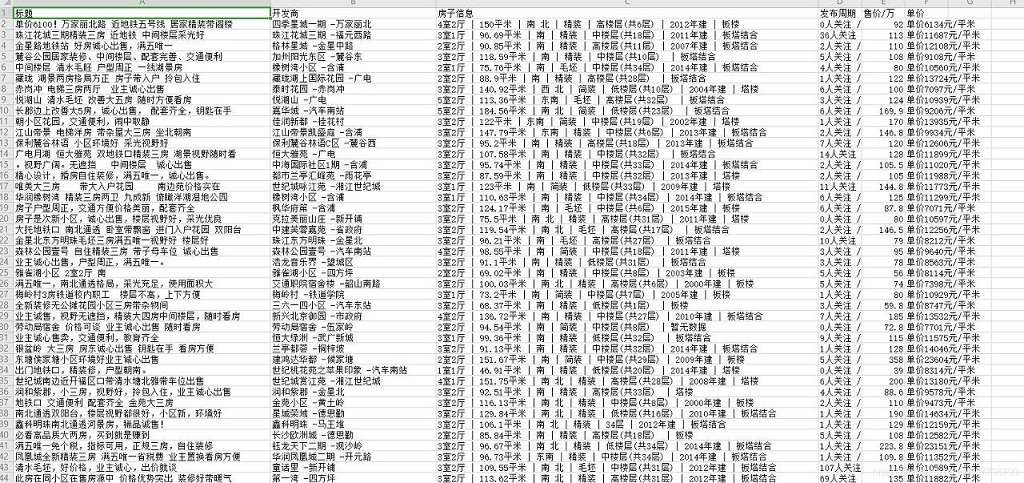

确定目标网页数据

哦豁,这个价格..................看到都觉得脑阔疼

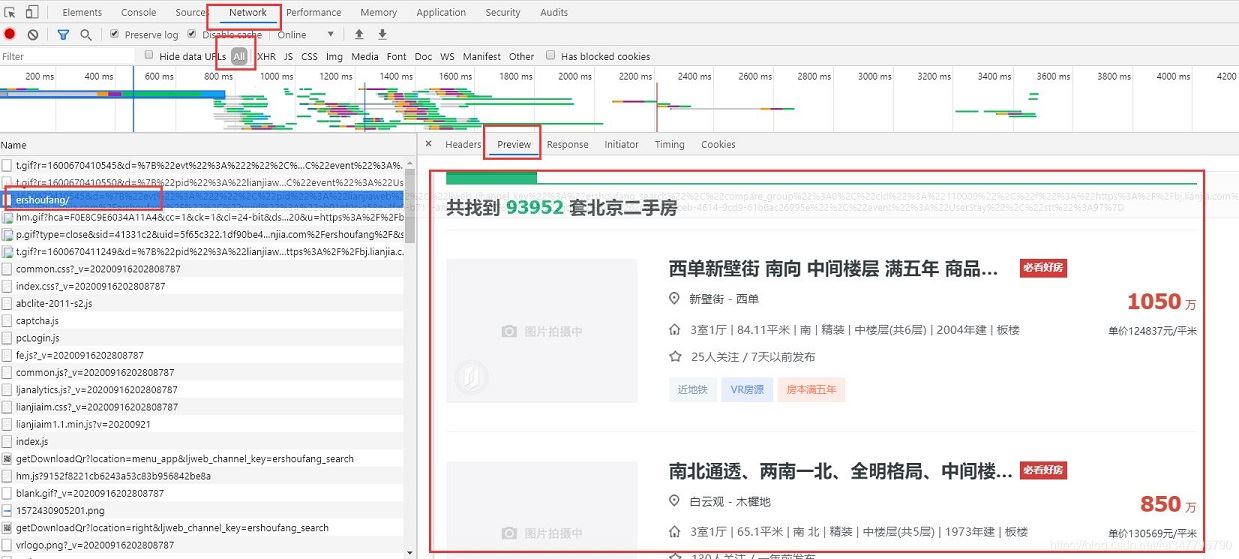

通过开发者工具,可以直接找到网页返回的数据~

每一个二手房的数据,都在网页的 li 标签里面,咱们可以获取网页返回的数据,然后通过解析,就可以获取到自己想要的数据了~

获取网页数据

import requests

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/81.0.4044.138 Safari/537.36'

}

response = requests.get(url=url, headers=headers)

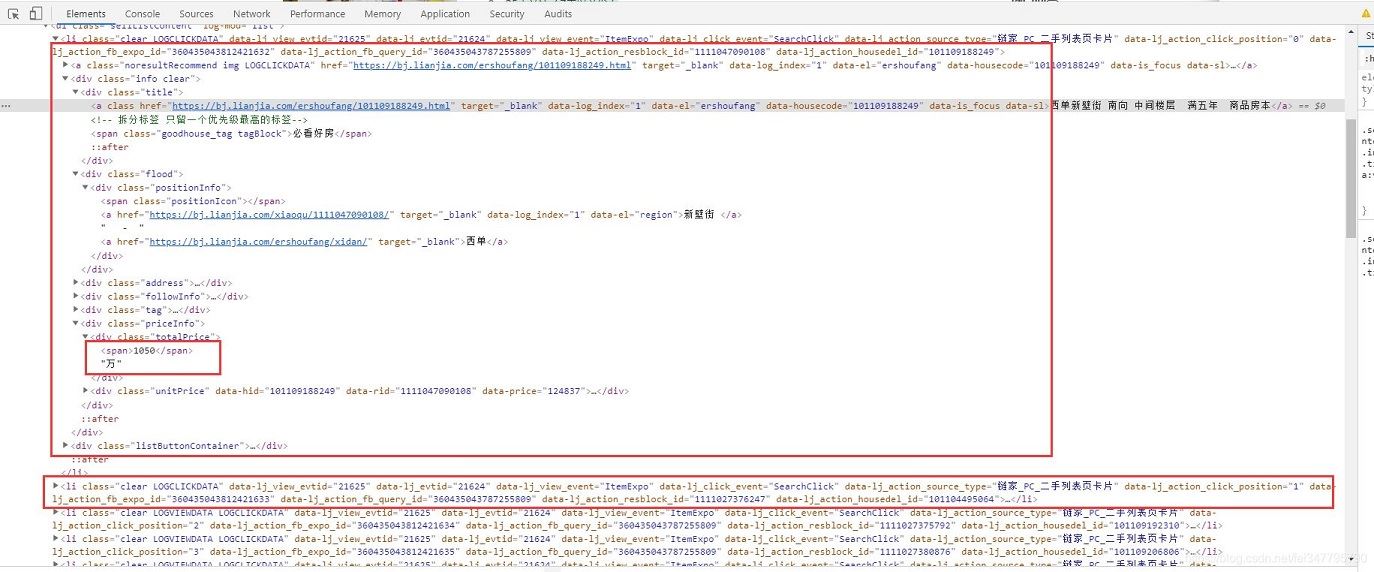

解析网页数据

import parsel

selector = parsel.Selector(response.text)

lis = selector.css('.sellListContent li')

dit = {}

for li in lis:

title = li.css('.title a::text').get()

dit['标题'] = title

positionInfo = li.css('.positionInfo a::text').getall()

info = '-'.join(positionInfo)

dit['开发商'] = info

houseInfo = li.css('.houseInfo::text').get()

dit['房子信息'] = houseInfo

followInfo = li.css('.followInfo::text').get()

dit['发布周期'] = followInfo

Price = li.css('.totalPrice span::text').get()

dit['售价/万'] = Price

unitPrice = li.css('.unitPrice span::text').get()

dit['单价'] = unitPrice

csv_writer.writerow(dit)

print(dit)

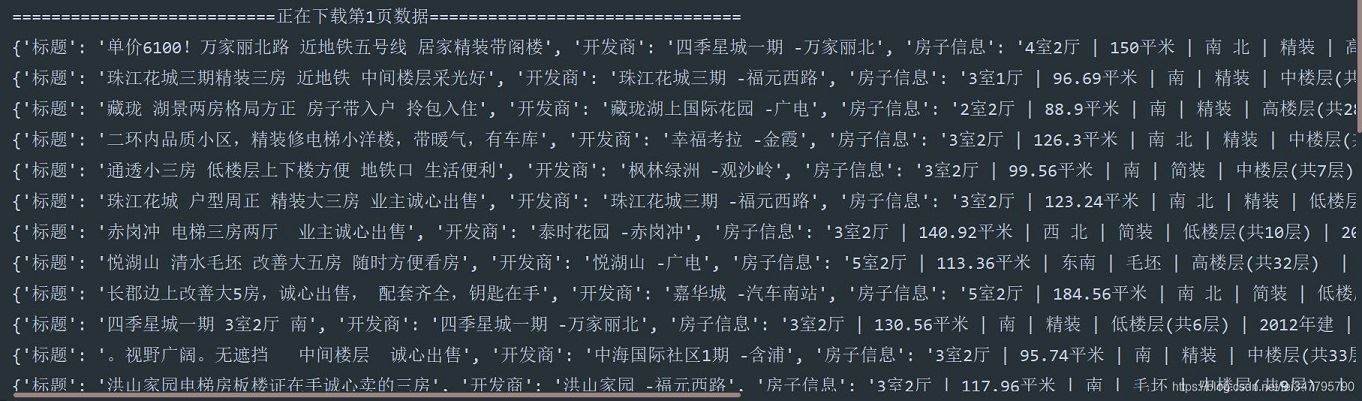

保存数据

import csv

f = open('二手房信息.csv', mode='a', encoding='utf-8-sig', newline='')

csv_writer = csv.DictWriter(f, fieldnames=['标题', '开发商', '房子信息', '发布周期', '售价/万', '单价'])

csv_writer.writeheader()

csv_writer.writerow(dit)

f.close()

以上就是本文的全部内容,希望对大家的学习有所帮助,也希望大家多多支持我们。

赞 (0)