在Tensorflow中查看权重的实现

刚开始学习tensorflow,还不太会用,开个博记录,今天遇到一个问题是用tf.layers.dense创建的全连接层,如何查看权重?

知道kernel表示了权重,但是如何提示成变量?

我分成两步:

1、查看tensor:tf.trainable_variables()

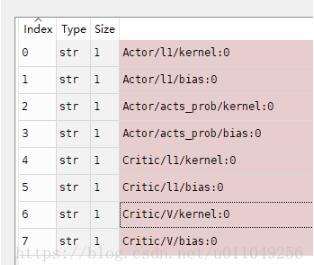

命令行里中运行即可,如下图:

可以看到tensor的name,或用更简洁的方式:variable_name = [v.name for v in tf.trainable_variables()]

运行后,trainable_variable()即存入variable_name中:

2、获取权重:tf.get_default_graph().get_tensor_by_name('variable_name')

如:w1=tf.get_default_graph().get_tensor_by_name('Actor/l1/kernel:0')

即可根据get tensor by name

菜鸟的笨方法^-^

—————————————————————————————————

更新:tf.get_collection(tf.GraphKeys.TRAINABLE_VARIABLES,scope)也可查看,可得到某scope下的tensor

即从某scope的tf.GraphKeys.TRAINABLE_VARIABLES中取出所有变量,是一个列表

以上这篇在Tensorflow中查看权重的实现就是小编分享给大家的全部内容了,希望能给大家一个参考,也希望大家多多支持我们。

相关推荐

-

tensorflow 保存模型和取出中间权重例子

下面代码的功能是先训练一个简单的模型,然后保存模型,同时保存到一个pb文件当中,后续可以从pd文件里读取权重值. import tensorflow as tf import numpy as np import os import h5py import pickle from tensorflow.python.framework import graph_util from tensorflow.python.platform import gfile #设置使用指定GPU os.envi

-

tensorflow输出权重值和偏差的方法

使用tensorflow 训练模型时,我们可以使用 tensorflow自带的 Save模块 tf.train.Saver()来保存模型,使用方式很简单 就是在训练完模型后,调用saver.save()即可 saver = tf.train.Saver(write_version=tf.train.SaverDef.V2) saver.save(sess, save_dir+"crfmodel.ckpt", global_step=0) 重新载入模型 saver = tf.train.

-

tensorflow 输出权重到csv或txt的实例

实例如下所示: import numpy as np W_val, b_val = sess.run([weights_tensor, biases_tensor]) np.savetxt("W.csv", W_val, delimiter=",") np.savetxt("b.csv", b_val, delimiter=",") 以上这篇tensorflow 输出权重到csv或txt的实例就是小编分享给大家的全部内容了,希

-

Tensorflow读取并输出已保存模型的权重数值方式

这篇文章是为了对网络模型的权重输出,可以用来转换成其他框架的模型. import tensorflow as tf from tensorflow.python import pywrap_tensorflow #首先,使用tensorflow自带的python打包库读取模型 model_reader = pywrap_tensorflow.NewCheckpointReader(r"model.ckpt") #然后,使reader变换成类似于dict形式的数据 var_dict =

-

TensorFlow中权重的随机初始化的方法

一开始没看懂stddev是什么参数,找了一下,在tensorflow/python/ops里有random_ops,其中是这么写的: def random_normal(shape, mean=0.0, stddev=1.0, dtype=types.float32, seed=None, name=None): """Outputs random values from a normal distribution. Args: shape: A 1-D integer Te

-

tensorflow 模型权重导出实例

tensorflow在保存权重模型时多使用tf.train.Saver().save 函数进行权重保存,保存的ckpt文件无法直接打开,不利于将模型权重导入到其他框架使用(如Caffe.Keras等). 好在tensorflow提供了相关函数 tf.train.NewCheckpointReader 可以对ckpt文件进行权重查看,因此可以通过该函数进行数据导出. import tensorflow as tf import h5py cpktLogFileName = r'./checkpoi

-

在Tensorflow中查看权重的实现

刚开始学习tensorflow,还不太会用,开个博记录,今天遇到一个问题是用tf.layers.dense创建的全连接层,如何查看权重? 知道kernel表示了权重,但是如何提示成变量? 我分成两步: 1.查看tensor:tf.trainable_variables() 命令行里中运行即可,如下图: 可以看到tensor的name,或用更简洁的方式:variable_name = [v.name for v in tf.trainable_variables()] 运行后,trainable_

-

对Tensorflow中权值和feature map的可视化详解

前言 Tensorflow中可以使用tensorboard这个强大的工具对计算图.loss.网络参数等进行可视化.本文并不涉及对tensorboard使用的介绍,而是旨在说明如何通过代码对网络权值和feature map做更灵活的处理.显示和存储.本文的相关代码主要参考了github上的一个小项目,但是对其进行了改进. 原项目地址为(https://github.com/grishasergei/conviz). 本文将从以下两个方面进行介绍: 卷积知识补充 网络权值和feature map的可

-

在Tensorflow中实现梯度下降法更新参数值

我就废话不多说了,直接上代码吧! tf.train.GradientDescentOptimizer(0.01).minimize(cross_entropy) TensorFlow经过使用梯度下降法对损失函数中的变量进行修改值,默认修改tf.Variable(tf.zeros([784,10])) 为Variable的参数. train_step = tf.train.GradientDescentOptimizer(0.01).minimize(cross_entropy,var_list=

-

tensorflow中next_batch的具体使用

本文介绍了tensorflow中next_batch的具体使用,分享给大家,具体如下: 此处给出了几种不同的next_batch方法,该文章只是做出代码片段的解释,以备以后查看: def next_batch(self, batch_size, fake_data=False): """Return the next `batch_size` examples from this data set.""" if fake_data: fake_i

-

对Tensorflow中tensorboard日志的生成与显示详解

TensorBoard是TensorFlow下的一个可视化的工具,能够帮助我们在训练大规模神经网络过程中出现的复杂且不好理解的运算.TensorBoard能展示你训练过程中绘制的图像.网络结构等. 1. 构建简单的TensorBoard日志输出 import tensorflow as tf input1 = tf.constant([1.0, 2.0, 3.0], name="input1") input2 = tf.Variable(tf.random_uniform([3], n

-

Tensorflow中k.gradients()和tf.stop_gradient()用法说明

上周在实验室开荒某个代码,看到中间这么一段,对Tensorflow中的stop_gradient()还不熟悉,特此周末进行重新并总结. y = xx + K.stop_gradient(rounded - xx) 这代码最终调用位置在tensoflow.python.ops.gen_array_ops.stop_gradient(input, name=None),关于这段代码为什么这样写的意义在文末给出. [stop_gradient()意义] 用stop_gradient生成损失函数w.r.

-

Tensorflow中批量读取数据的案列分析及TFRecord文件的打包与读取

单一数据读取方式: 第一种:slice_input_producer() # 返回值可以直接通过 Session.run([images, labels])查看,且第一个参数必须放在列表中,如[...] [images, labels] = tf.train.slice_input_producer([images, labels], num_epochs=None, shuffle=True) 第二种:string_input_producer() # 需要定义文件读取器,然后通过读取器中的

-

tensorflow中的数据类型dtype用法说明

Tensorflow中,主要有以下几种数据类型(dtype),在旧版本中,不用加tf也能使用. 有符号整型 tf.int8:8位整数. tf.int16:16位整数. tf.int32:32位整数. tf.int64:64位整数. 无符号整型 tf.uint8:8位无符号整数. tf.uint16:16位无符号整数. 浮点型 tf.float16:16位浮点数. tf.float32:32位浮点数. tf.float64:64位浮点数. tf.double:等同于tf.float64. 字符串型

-

Visual Studio 2017中找回消失的“在浏览器中查看”命令

不知为何,在新安装 Visual Studio 2017 后,发现所有 Web 项目上右键菜单的"在浏览器中查看"命令消失了,只能以调试模式启动网站,非常别扭. 最后在 Stackoverflow 上找到了遇到同样问题的解决方法:通过自定义菜单将此命令添加回来. 1.在工具栏上右键,选择"自定义": 2.在弹出的窗口中,选择"命令"标签.然后选择"上下文菜单",在其右侧下拉列表中找到"项目和解决方案上下文菜单 | 项

-

python中查看变量内存地址的方法

本文实例讲述了python中查看变量内存地址的方法.分享给大家供大家参考.具体实现方法如下: 这里可以使用id >>> print id.__doc__ id(object) -> integer Return the identity of an object. This is guaranteed to be unique among simultaneously existing objects. (Hint: it's the object's memory address

随机推荐

- jQuery html() in Firefox (uses .innerHTML) ignores DOM changes

- jsonp跨域请求数据实现手机号码查询实例分析

- Vue.js中组件中的slot实例详解

- 给vue项目添加ESLint的详细步骤

- Windows 2000/XP 下巧拒强行关机的方法

- SQL获取表结构的show_table.vbs (冰点极限NP)

- c# 正则表达式对网页进行有效内容抽取

- spring中定时任务taskScheduler的详细介绍

- 在WinForm和WPF中使用GMap.Net地图插件简单教程

- 代码实现打印功能(asp.net+javascript)

- JS实现控制表格行文本对齐的方法

- 才发现的超链接js导致网页中GIF动画停止的解决方法

- php用正则表达式匹配URL的简单方法

- Python实现的微信公众号群发图片与文本消息功能实例详解

- CentOS 7 中以命令行方式安装 MySQL 5.7.11 for Linux Generic 二进制版本教程详解

- jQuery轻松实现表格的隔行变色和点击行变色的实例代码

- JQuery在循环中绑定事件的问题详解

- discuz Passport 通行证 整合笔记

- RecyclerView的使用之HelloWorld

- jQuery Datatables表头不对齐的解决办法