浅谈TensorFlow之稀疏张量表示

对于多维的稀疏数据,TensorFlow 支持 SparseTensor 表示。

官方文档地址:https://tensorflow.google.cn/api_guides/python/sparse_ops

构造稀疏张量

SparseTensor(indices, values, dense_shape)

indices是一个维度为(n, ndims)的2-D int64张量,指定非零元素的位置。比如indices=[[1,3], [2,4]]表示[1,3]和[2,4]位置的元素为非零元素。n表示非零元素的个数,ndims表示构造的稀疏张量的维数。

values是一个维度为(N)的1-D张量,对应indices所指位置的元素值。

dense_shape是一个维度为(ndims)的1-D张量,代表稀疏张量的维度。

tf.SparseTensor(indices=[[0, 0], [1, 2]], values=[1, 2], dense_shape=[3, 4]) >> [[1, 0, 0, 0] [0, 0, 2, 0] [0, 0, 0, 0]]

转换

将稀疏张量转为普通矩阵。

tf.sparse_to_dense( sparse_indices, output_shape, sparse_values, default_value=0, validate_indices=True, name=None )

sparse_indices是那些非零元素的位置。

sparse_indices是实数,该矩阵为一维矩阵,指定一维矩阵的某一个元素位置

sparse_indices是向量,该矩阵为一维矩阵,指定一维矩阵的多个元素

sparse_indices是二维矩阵,该矩阵为多维矩阵,指定多维矩阵的多个元素。

output_shape是矩阵的维度。

sparse_value是对应sparse_indices所指位置的元素值。

default_value是未指定元素的默认值,一般为0。

import tensorflow as tf mysparse_indices = tf.constant(5) mymatrix = tf.sparse_to_dense(mysparse_indices, [11], 10) with tf.Session() as sess: result = sess.run(mymatrix) print(result) //[0 0 0 0 0 10 0 0 0 0 0]

SparseTensor和SparseTensorValue

两者的参数相同。

在计算图中定义稀疏张量时,使用SparseTensor;在feed数据时使用SparseTensorValue。

补充知识:彻底搞懂tensorflow里的张量(tensor)

1.引言

学习卷积神经网络(CNN)的时候,最重要的就是搞清楚网络各层的神经元输入输出的数据结构(即张量)。如果仅用线性代数所学的矩阵,向量来理解张量,一定会搞得一头雾水。因此很有必要搞清楚张量是什么东西。

首先明确:张量最主要的两个参数: rank(阶,或维数)、shape(形状)

2.什么是张量

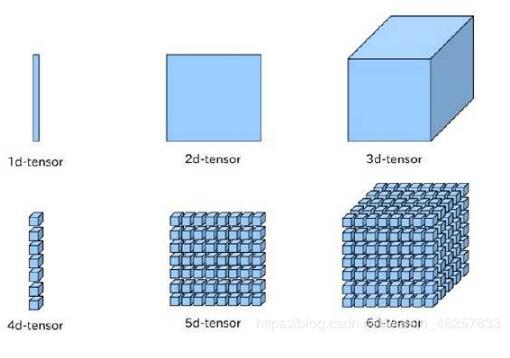

下图是张量的直观的示意:张量是标量、向量、矩阵的集合和推广。

3.什么是rank

| rank | 数学实例 | Python 例子 |

|---|---|---|

| 0 | 纯数字(只有大小) | s=352 |

| 1 | 向量(1个基本向量) | v = [1.1, 2.2, 3.3] |

| 2 | 矩阵(两个基本向量) | m = [[1, 2, 3], [4, 5, 6], [7, 8, 9]] |

| 3 | 数据立体(3个基本向量) | t = [ [[2], [4], [6]] , [[8], [10], [12]] , [[14], [16], [18]] ] |

| n | n个基本向量 | … |

可以发现:可以数括号[ ]的层数来确定张量的维数(阶)

什么是基本向量

基本向量(basis vector):几个basis vector就是从几个方面来描述一组数据。

举例说明:

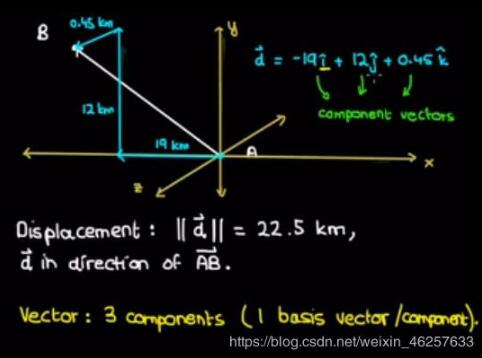

一维张量:概念和向量完全一样。图中的白线就是一个向量,当然了,在三维空间向量有三个分向量(分别是x方向、y方向、z方向)

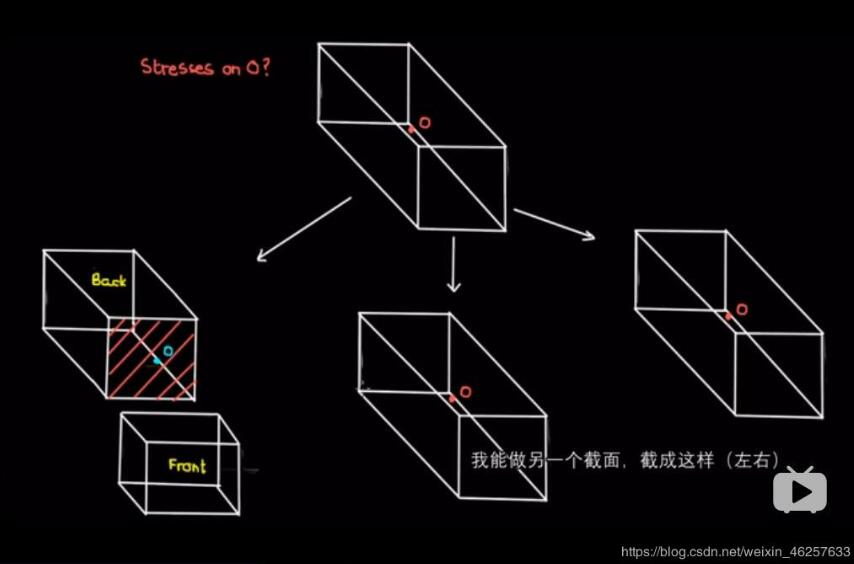

二维张量:对下面这个长方形施加一个力,怎么来描述?

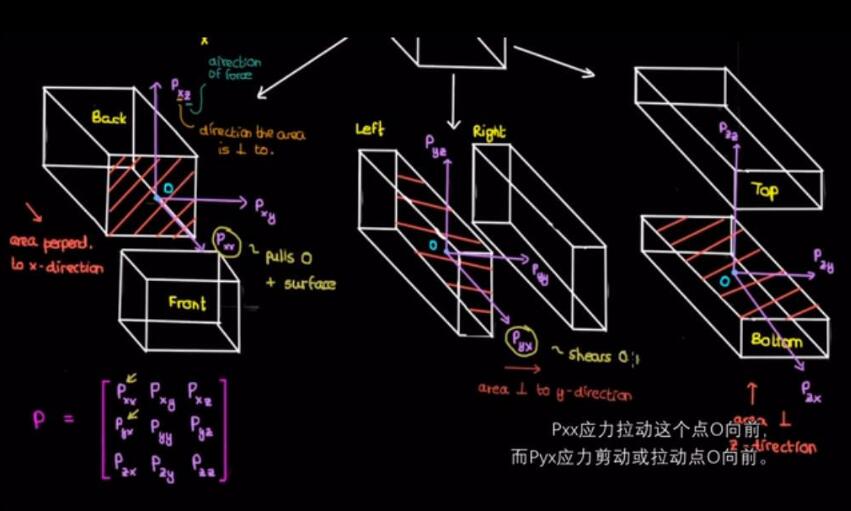

我们把可以把这个长方形就xoy、xoz、yoz三个平面截下来,之后在每一个平面上再分析受力情况。

两个basis vector出来了:一个用来描述截面方向(这是一个三维向量);另一个用来描述此截面的受力情况(当然这也是一个三维向量)

那么我们可以用作用在yoz平面(此平面的法向量是x轴单位向量),受力的x轴分量用Pxx来表示,以此推广到含有9个元素的矩阵,这就是一个2维张量。

换句话来解释:在一个三维空间,我们从2个基本向量来描述一个东西,那么这个张量所含有的元素个数应该是3的2次方等于9个。每个元素能得到2个基本向量的注释。这就是一个2维的张量

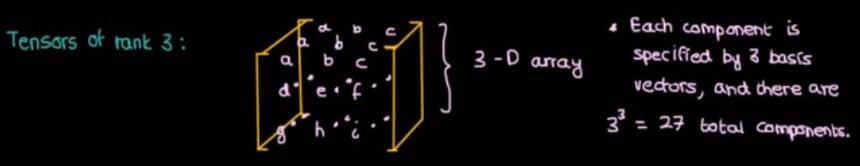

三维张量:

继续推广,每个元素有三个基本向量注释。三维的张量形状就像是叠起来的矩阵。

最后品一品这句话

4.什么是shape

shape指明每一层有多少个元素。

比如[2,3,4]是指第一层2个元素,第二层3个元素,第三层4个元素,通过这个我们就可以知道这个张量一共有2 × 3 × 4=24 个元素。而且它有3层,因此可以知道这个张量的rank=3

注意:读取元素,从外括号往内括号读

下面这个代码也能说明问题。

import tensorflow as tf # 定义了一个张量,有6个元素,设置他的形状是[2.3] a = tf.constant([1, 2, 3, 4, 5, 6], shape=[2,3]) with tf.Session() as session: print(session.run(a))

打印的结果是

[[1 2 3] [4 5 6]]

以上这篇浅谈TensorFlow之稀疏张量表示就是小编分享给大家的全部内容了,希望能给大家一个参考,也希望大家多多支持我们。