机器学习数据预处理之独热One-Hot编码及其代码详解

目录

- 1. 为什么使用 one-hot 编码?

- 问题:

- 目的:

- 瓶颈:

- 2. 什么是 one-hot 编码?

- 定义:

- 理解:

- 举例1:

- 举例2:

- 3. one-hot 编码优缺点?

- 优点:

- 缺点:

1. 为什么使用 one-hot 编码?

问题:

在机器学习算法中,我们经常会遇到分类特征,例如:人的性别有男女,祖国有中国,美国,法国等。 这些特征值并不是连续的,而是离散的,无序的。

目的:

如果要作为机器学习算法的输入,通常我们需要对其进行特征数字化。什么是特征数字化呢?例如:

性别特征:["男","女"]

祖国特征:["中国","美国,"法国"]

运动特征:["足球","篮球","羽毛球","乒乓球"]

瓶颈:

假如某个样本(某个人),他的特征是["男","中国","乒乓球"] ,我们可以用 [0,0,4] 来表示,但是这样的特征处理并不能直接放入机器学习算法中。因为类别之间是无序的。

2. 什么是 one-hot 编码?

定义:

独热编码即 One-Hot 编码,又称一位有效编码。其方法是使用 N位 状态寄存器来对 N个状态 进行编码,每个状态都有它独立的寄存器位,并且在任意时候,其中只有一位有效。

理解:

One-Hot 编码是分类变量作为二进制向量的表示。

(1) 将分类值映射到整数值。

(2) 然后,每个整数值被表示为二进制向量,除了整数的索引之外,它都是零值,它被标记为1。

举例1:

举个例子,假设我们有四个样本(行),每个样本有三个特征(列),如图:

上述feature_1有两种可能的取值,比如是男/女,这里男用1表示,女用2表示。feature_2 和 feature_3 各有4种取值(状态)。

one-hot 编码就是保证每个样本中的单个特征只有1位处于状态1,其他的都是0。

上述状态用 one-hot 编码如下图所示:

举例2:

按照 N位状态寄存器 来 对N个状态 进行编码的原理,处理后应该是这样的

性别特征:["男","女"] (这里只有两个特征,所以 N=2):

男 => 10

女 => 01

祖国特征:["中国","美国,"法国"](N=3):

中国 => 100

美国 => 010

法国 => 001

运动特征:["足球","篮球","羽毛球","乒乓球"](N=4):

足球 => 1000

篮球 => 0100

羽毛球 => 0010

乒乓球 => 0001

所以,当一个样本为 ["男","中国","乒乓球"] 的时候,完整的特征数字化的结果为:

[1,0,1,0,0,0,0,0,1]

下图可能会更好理解:

python 代码示例:

from sklearn import preprocessing enc = preprocessing.OneHotEncoder() enc.fit([[0,0,3],[1,1,0],[0,2,1],[1,0,2]]) # 训练。这里共有4个数据,3种特征 array = enc.transform([[0,1,3]]).toarray() # 测试。这里使用1个新数据来测试 print array # [[ 1 0 0 1 0 0 0 0 1]] # 独热编码结果

以上对应关系可以解释为下图:

3. one-hot 编码优缺点?

优点:

(1) 解决了 分类器不好处理离散数据 的问题。

a. 欧式空间。在回归,分类,聚类等机器学习算法中,特征之间距离计算 或 相似度计算是非常重要的,而我们常用的距离或相似度的计算都是在欧式空间的相似度计算,计算余弦相似性,基于的就是欧式空间。

b. one-hot 编码。使用 one-hot 编码,将离散特征的取值扩展到了欧式空间,离散特征的某个取值 就 对应欧式空间的某个点。将离散型特征使用 one-hot 编码,确实会让特征之间的距离计算更加合理。

(2) 在一定程度上也起到了 扩充特征 的作用。

缺点:

在文本特征表示上有些缺点就非常突出了。

(1) 它是一个词袋模型,不考虑词与词之间的顺序(文本中词的顺序信息也是很重要的);

(2) 它假设词与词相互独立(在大多数情况下,词与词是相互影响的);

(3) 它得到的特征是离散稀疏的 (这个问题最严重)。

上述第3点展开:

(1) 为什么得到的特征是离散稀疏的?

例如,如果将世界所有城市名称作为语料库的话,那这个向量会过于稀疏,并且会造成维度灾难。如下:

杭州 [0,0,0,0,0,0,0,1,0,……,0,0,0,0,0,0,0]

上海 [0,0,0,0,1,0,0,0,0,……,0,0,0,0,0,0,0]

宁波 [0,0,0,1,0,0,0,0,0,……,0,0,0,0,0,0,0]

北京 [0,0,0,0,0,0,0,0,0,……,1,0,0,0,0,0,0]

在语料库中,杭州、上海、宁波、北京各对应一个向量,向量中只有一个值为1,其余都为0。

(2)能不能把词向量的维度变小呢?

a) Dristributed representation:

可以解决 One hot representation 的问题,它的思路是:

1. 通过训练,将每个词都映射到一个较短的词向量上来。

2. 所有的这些 词向量 就构成了 向量空间,

3. 进而可以用 普通的统计学的方法 来研究词与词之间的关系。

这个较短的词向量维度是多大呢?这个一般需要我们在训练时自己来指定。

b) 举例:

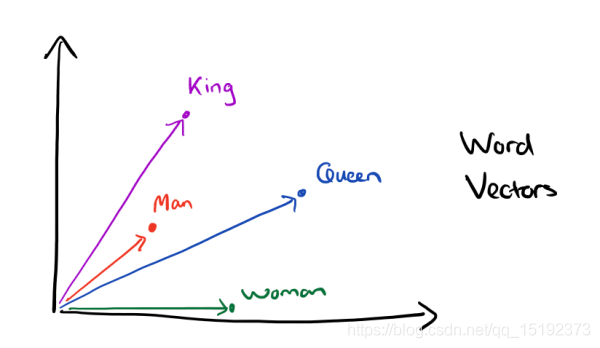

1. 比如将词汇表里的词用 "Royalty", "Masculinity", "Femininity" 和 "Age" 4个维度来表示,King 这个词对应的词向量可能是 (0.99,0.99,0.05,0.7)。

2. 在实际情况中,并不能对词向量的每个维度做一个很好的解释。

3.将king这个词从一个可能非常稀疏的向量坐在的空间,映射到现在这个 四维向量 所在的空间,必须满足以下性质:

(1)这个映射是单射;

(2)映射之后的向量 不会丢失之前的 那种向量 所含的信息 。

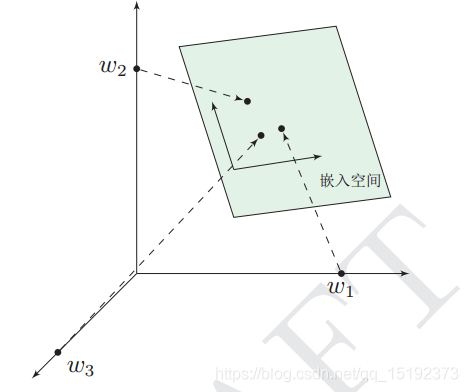

4.这个过程称为word embedding(词嵌入),即将高维词向量嵌入到一个低维空间。如图:

5.经过我们一系列的降维神操作,有了用 representation 表示的较短的词向量,我们就可以较容易的分析词之间的关系了,比如我们将词的维度降维到 2维,有一个有趣的研究表明,用下图的词向量表示我们的词时,我们可以发现:

6. 出现这种现象的原因是,我们得到最后的词向量的训练过程中引入了词的上下文。举例:

想到得到 "learning" 的词向量,但训练过程中,你同时考虑了它左右的上下文,那么就可以使 "learning" 带有语义信息了。通过这种操作,我们可以得到近义词,甚至 cat 和它的复数 cats 的向量极其相近。

--------------------------------------------------------------------

参考博客:

到此这篇关于机器学习数据预处理之独热One-Hot编码及其代码详解的文章就介绍到这了,更多相关one-hot 编码内容请搜索我们以前的文章或继续浏览下面的相关文章希望大家以后多多支持我们!