pytorch tensor计算三通道均值方式

目录

- tensor计算三通道均值

- 第一种思路

- Pytorch tensor的运算

- tensor操作

tensor计算三通道均值

今天用pytorch处理图像时,涉及到了计算均值的问题,整理一下解决思路。

第一种思路

tensor转换为numpy再进行处理

import torch

import cv2

img = cv2.imread("image path")

tensor_img = torch.from_numpy((img[:, :, ::-1] / 255.0)[None, ...].transpose(0, 3, 1, 2)).cuda()

...

numpy_img = (tensor_img.detach().cpu().numpy().transpose(2, 3, 1, 0).squeeze() * 255)[:, :, ::-1]

ave_color = np.mean(numpy_img , axis=(0, 1))

如果图像里有0值,不想计入运算:

numpy_img[numpy_img == 0] = np.nan ave_color = np.nanmean(numpy_img, axis=(0, 1))

由于tensor和numpy来回转换会消耗资源、性能。

又查了一番,直接在tensor中计算(非零均值计算)

reshape_tensor_img = tensor_img.view(tensor_img.size(0), tensor_img.size(1), -1) ave_color = reshape_tensor_img.mean(2) # mean value without 0 non_zero_img = reshape_tensor_img[reshape_tensor_img.nonzero(as_tuple=True)] ave_color = non_zero_img.view(reshape_tensor_img.size(0), reshape_tensor_img.size(1), -1).mean(2)

计算完均值,想要加法运算的时候也会碰上一点维度上的麻烦,需要维度转换一下。

reshape_ave_color = ave_color.view(ave_color.size(0), ave_color.size(1), 1, 1) add_img = tensor_img + reshape_ave_color

Pytorch tensor的运算

tensor操作

1. 新建

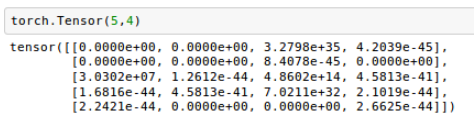

A、torch.Tensor(shape)/torch.FloatTensor(shape):随机初始化一个维度为shape的张量。

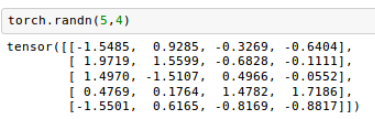

B、torch.randn(shape):用均值为0,方差为1的高斯分布初始化一个shape的张量。

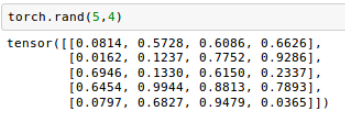

C、torch.rand(shape):在区间[0,1]上均匀分布,初始化一个shape的张量。

2、Tensor的变换

A、view / reshape

两个用法差不多,都是用来改变一个张量的数据分布。

注:(2,-1)中的-1会自动计算剩下的维度。

B、squeeze / unsqueeze

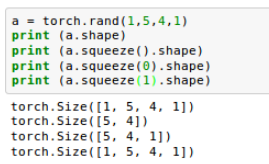

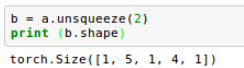

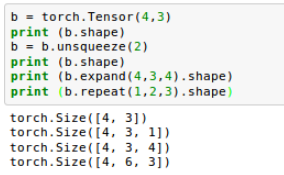

第一个是用来压缩维度为1的张量,如(6,1,32,32).squeeze()之后就变为(6,32,32);第二个是用来增加一个维度。具体看实例如下:

注:squeeze中不带参数,是将所有维度为1的地方去掉,带参数是去指定维度为1的地方,若指定的维度不为1,则不变。

注:在指定的维度上插入一个大小为1的新维度。

C、expand / repeat

这两个都是进行数据的扩充操作,第一个是扩充到指定的维度大小,第二个函数的参数维度上扩充的倍数。一般结合上面2.B中的函数使用。

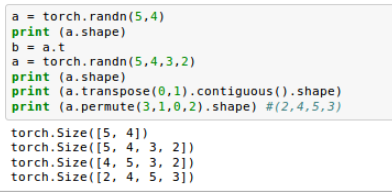

D、 t / transpose / permute

这三个函数用来数据维度之间的调整,第一个只能用于2D。

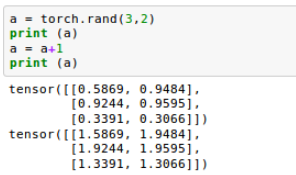

E、broadcasting机制

相当于自动完成了unsqueeze+expand的操作,但是相比节省内存空间。

通过broadcasting机制,张量可以直接和标量进行相加。

以上为个人经验,希望能给大家一个参考,也希望大家多多支持我们。