pytorch中Parameter函数用法示例

目录

- 用法介绍

- 代码介绍

用法介绍

pytorch中的Parameter函数可以对某个张量进行参数化。它可以将不可训练的张量转化为可训练的参数类型,同时将转化后的张量绑定到模型可训练参数的列表中,当更新模型的参数时一并将其更新。

torch.nn.parameter.Parameter

- data (Tensor):表示需要参数化的张量

- requires_grad (bool, optional):表示是否该张量是否需要梯度,默认值为True

代码介绍

pytorch中的Parameter函数具体的代码示例如下所示

import torch import torch.nn as nn class NeuralNetwork(nn.Module): def __init__(self, input_dim, output_dim): super(NeuralNetwork, self).__init__() self.linear = nn.Linear(input_dim, output_dim) self.linear.weight = torch.nn.Parameter(torch.zeros(input_dim, output_dim)) self.linear.bias = torch.nn.Parameter(torch.ones(output_dim)) def forward(self, input_array): output = self.linear(input_array) return output if __name__ == '__main__': net = NeuralNetwork(4, 6) for param in net.parameters(): print(param)

代码的结果如下所示:

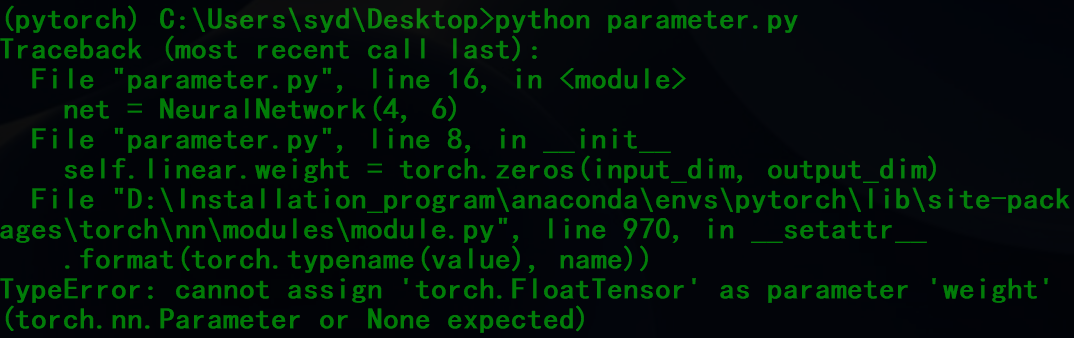

当神经网络的参数不是用Parameter函数参数化直接赋值给权重参数时,则会报错,具体的程序

import torch import torch.nn as nn class NeuralNetwork(nn.Module): def __init__(self, input_dim, output_dim): super(NeuralNetwork, self).__init__() self.linear = nn.Linear(input_dim, output_dim) self.linear.weight = torch.zeros(input_dim, output_dim) self.linear.bias = torch.ones(output_dim) def forward(self, input_array): output = self.linear(input_array) return output if __name__ == '__main__': net = NeuralNetwork(4, 6) for param in net.parameters(): print(param)

代码运行报错结果如下所示:

以上就是pytorch中Parameter函数用法示例的详细内容,更多关于pytorch中Parameter函数的资料请关注我们其它相关文章!

赞 (0)